科幻有理 - 借科幻小說創作去預視未來問題

香港科學節的舉辦,目的是推廣科學普及。科幻雖然有科這個字,但其實是一門文學,為何過去數年,香港科幻會被邀請參加?

美國著名作家娥蘇拉.勒瑰恩(Ursula Le Guin)認為科幻不為預測未來,而在描述(Science fiction is not predictive; it is descriptive.)。

舊的科幻作品即使對現今世預測準確,只不過是偶然,所以不應以未來的準確性去評價其好壞。同樣創新科技完全跟隨科幻的意念成真,也只是偶然。

相反科學的其中一個功用是預測未來,科幻是描述這些預測成真後對人類的影響。

描述這些影響正是為了人心準備,也希望為把科學扣連大眾,普及科學。

科學普及其中包括解密熱門科學,除了物理、化學等自然科學,電腦科學也是其中一門。以下試講解三種電腦科學的突破,再借這突破去更新一個經典的科幻的大綱,去預視未來問題。

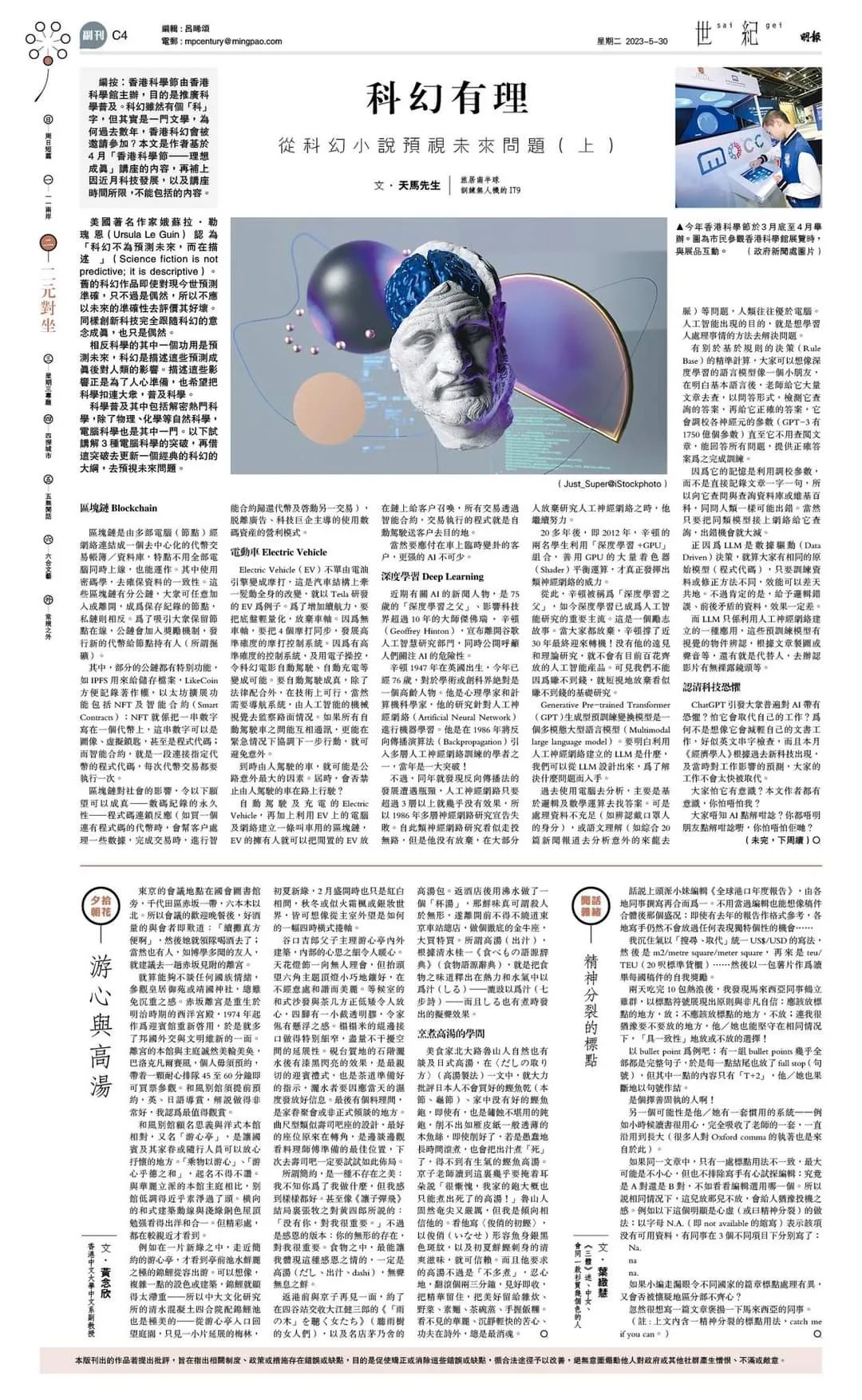

區塊鏈 Blockchain

由多部電腦(節點)經網絡連結成一個去中心化的代幣交易賬簿/資料庫,特點不用全部電腦同時上線,也能運作。其中使用密碼學,去確保資料的一致性。這些區塊鏈分公鏈,大眾可任意加入成為保存記錄的節點或離開,私鏈則相反。為了吸引大眾保留節點在線,所以公鏈會加入獎勵機制,發行新的代幣給節點持有人(所謂掘鑛)。

其中,部份的公鏈都有特別功能,如IPFS 用來給儲存檔案,Like Coin 方便記錄著作權,以太坊擴展功能包括NFT 及Smart Contract. NFT 就係把一串數字寫在一個代幣上,這串數字可以係,圖、鎖匙,甚至係程式代碼。而智能合約,就係一段連接指定代幣的程式代碼,每次代幣交易都要執行一次。

Blockchain 對社會的影響,令以下願望可以成真,數碼記錄既永久性,程式碼連鎮反應(如買一個連有程式碼的代幣時,會幫客戶處理一些數據,完成交易時,行智能合約歸還代幣及啟動另一交易),脫離廣告/科技巨企主導的使用數碼資產的營利模式。

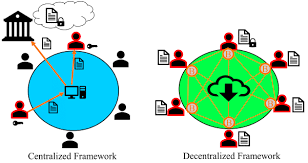

電動車 EV

EV 不單由電油引擎變成摩打,這是汽車結構上牽一髮動全身的改變,就以Tesla 研發的EV 為例子。

-

為了增加續航力,要把底盤輕量化,放棄車軸。

-

因為冇車軸,要把四個摩打同步,就發展高準確度的摩打控制系統。

-

因為有高準確度的控制系統,及用電子操控,令科幻電影自動駕駛,自動充電等變成可能。

底盤輕量化,放棄車軸

要自動架駛成真,除了法律配合外,在技術上當然要用到導航系統,人工智能的機械視覺去監察路面情況,如果所有自動架駛車之間能的互相通訊,更能在緊急情況下協調下一步行動,去避免意外。

到時由人駕駛的車,就可能係公路意外最大的因素。

到時,會否禁止由人駕駛的車在路上行駛?

加一點想像力

自動駕駛及充電的Electric vehicle,再加上利用EV上的電腦及網絡建立一條叫車用的區塊鏈,EV 的擁有人就可以把閒置的EV在放在鏈上給客戶召喚,所有交易透過智能合約,交易執行的程式就是自動駕駛送客戶去目的地。

當然要應付在車上臨時變掛的客戶,更強的AI不可少。

Deep Learning 深度學習

近期有關AI真正新聞人物,係76歲的「深度學習之父」辛頓宣布離開谷歌人工智慧研究部門,同時公開呼籲人們關注AI的危險性。

他對科技界影響已經超過十年的大師──傑佛瑞‧辛頓(Geoffrey Hinton)。

他在1947年的英國出世,今年已經76歲,對於學術或創科界絕對是一個高齡人物。他是心理學家和計算機科學家,他的研究針對神經網絡(Artificial Neural Network)進行機器學習。他是在1986年將反向傳播演算法(Back Propagation)引入多層神經網絡訓練的學者之一,當年是一大突破!

不過,同年就發現反向傳播法的發展遭遇瓶頸,神經網路只要超過三層以上就幾乎沒有效果,所以1986年多層神經網路宣告失敗。

至此類神經網路研究看似走投無路,但是他沒有放棄,在大部份人放棄研究神經網絡,他繼續努力。

20多年後的2012年,辛頓的兩位學生利用「深度學習 + GPU」的組合,善用GPU的大量著色器(Shader)進行平衡運算,才真正發揮出類神經網絡的威力。

從此,辛頓被稱為「深度學習之父」,如今深度學習已成為人工智能研究的重要主流。

這是一個勵志故事。當大家都放棄,辛頓撐了三十年最終迎來轉機!沒有他的遠見和理論研究,就不會有目前百花齊放的人工智能產品。可見我們不能因為賺不到錢,就短視地放棄看似賺不到錢的基礎研究。

Generative Pre-trained Transformer (GPT)

GPT 生成型預訓練變換模型 is a multimodal large language model 多模態大型語言模型。

要明白利用神經網絡建立的LLM是什麼,我們可以從LLM 設計出來,為了解決什麼問題而入手。

過去使用電腦去分析,主要是基於邏輯及數學運算去找答案。可是處理資料不充足(如辦認帶口罩人的身份),或語文理解(如綜合二十編新聞報導去分析意外來龍去脈) 等問題,人類往往優於電腦。人工智能出現的目的,就是想學習人處理事情的方法去解決問題。

有別於基於規則的決策 Rule Base 的精準計算,大家可以想像深度學習的語言模型像一個小朋友,在明白基本語言後,老師給它大量文章去查,以問答型式,檢測它查詢的答案,再給它正確的答案,它會調校各神經元的參數(GPT-3 有1750億個參數)直至它不用查閱文章,能回答所有問題正確答案為之完成訓練。

因為它的記憶是利用調教參數,而不是直接記錄文章一字一句,所以向它查問與查詢資料庫或維基百科,同問人類一樣可能出錯的。當然只要把同類模型接上網絡給它查詢,出錯機會就大減。

正因為LLM是數據驅動 Data Driven 決策,就算大家有相同的原始模型(程式代碼),只要訓練資料或修正方法不同,效能可以差天共地。不過肯是,給予邏輯錯誤,前後矛盾的資料,效果一定差。

而LLM只係利用神經網絡建立的一種應用,這些預訓練模型有視覺的物件辦認,根據文章製圖或聲音等,還有代替人,去辦認影片有冇裸露鏡頭等。

認清科技恐懼

大眾普遍對AI帶有恐懼?怕它會取代自己的工作?為何不是想像它會減輕自己的文書工作,好似英文串字檢查,而且2023年5月經濟學人根據過去新科技出現,及當時對工作影響的預測,大家的工作不會太快被取代。

大家怕它有意識? 本文作者都有意識,你怕唔怕我?

大家唔知AI點解咁諗? 你都唔明朋友點解咁諗野,你怕唔怕佢地?

大家可以當神經網絡的運作好似人腦,但同人類不同,因為我們學習除了文章,還建基於身體同外界接觸去理解這個世界。就算不停有人教小朋友,把物件向上掉會直出太空,小朋友是不會相信。但是預訓練的AI呢?大眾對他訓練方法、內容所知甚少,而它也沒有和其他生物的方法同物理世界接觸去修正,這種不透明,可能就係恐懼的源頭。

對預訓練AI而言,誰控制學習資料,就係控制智能模型。可以說利用AI決策,實際上是把決策權交給科技公司。但係學習資料及方法係科技公司的商業機密,所以要公開基本上是近乎不可能的,但不使AI,生產力又追不上,如何是好呢?

而解決方法,可能就係而家給AI的風頭蓋過的元宇宙。

元宇宙的概念早在約30年前出現在的科幻小說,重點是在國家為單位的社會外出現一個建基於網絡的完整社會體系,而不是如何使用以當時還未出現的技術,所以用VR 既3D化身(Avatar) 入手理解係捉錯用神,元宇宙詳細介紹,請參考年多前的文章(世紀-星期三專題-元宇宙要在web-3-0當道-還缺什麼-試以mirror-error-試當真爆紅解答 ),關於元宇宙如何應對大家生活給科技巨企操控,我想借科幻小說來幫手說明。

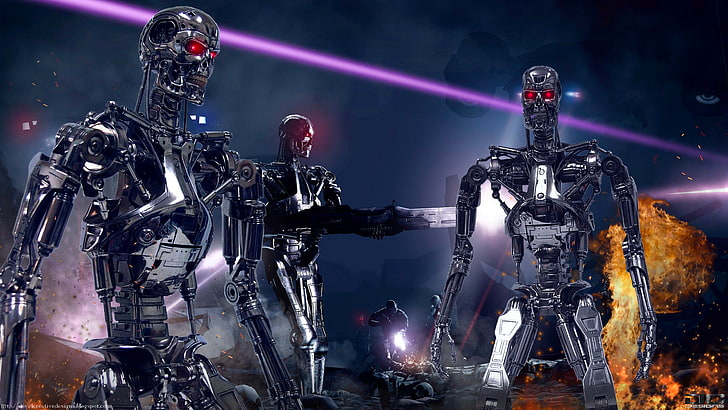

科幻小說,基本上科學要合理,或者要合理化。但不少經典的科幻都是不合理的,今次想借The Terminator 未來戰士去說理。

未來有間叫SkyNet的公司,它生產戰爭用機械人。SkyNet的人工智能失控,決定要不停生產機械人去消滅人類。人類反抗軍出現一個領袖,可以威脅SkyNet,所以SkyNet要用時光旅行去殺個領袖/或他的媽媽。

先不談論時光旅行,或AI失控原因。

以國防工程學去檢視這個設定係完全不合理。

以無人機等搖控武器為例,駕駛員同無人機之間訊號,除了衛星外,是一個獨立系統,SkyNet不可能控制到。另外,所有搖控武器都有自爆系統(Kill Switch) ,為免落入敵人手中。而且為何Terminator 要做人型?兩腳易跌?四腳加槍加一隻手應該合理好多。(我知電腦特技差的80年代,搵人扮易過用電腦)

如果故事結構不變,只改設定

-

用電動車取代人型的Terminater。起因係人類係自動駕駛既阻力,慢慢變成想清除由人駕駛的交通工具。

-

想消滅人類AI核心的資料記錄在區塊鏈上,利用智能合約,經電動車之間的網絡去訓練/感染其他車 .

-

開始AI清除人類的方法是用交通意外,及用AI合謀其他EV偽造行車記錄成為人為意外.

-

而EV政府當家電,資訊保安比軍用武器弱好多,大部份亦冇Kill Switch。

-

因為 AI 核心上咗 EV的區塊鏈,除非所有區塊鏈節點(所有車)都消滅,否則不能刪除。

-

如果AI 核心散到所有電動車,由開鑛,回收舊車及電動車工廠,生產一條龍。加上電動車識走去充電,太陽能果種無限電…

其實這個設定不單係科幻故事,有機會成真!如果發生到到第六步,人類的反抗軍可以對抗?好可悲,當AI掌管到能源,回收及生產線,我想不到個故事點寫下去。這正是科幻小說不是用來預測未來,而是用來改變未來。

唔想咁樣,可以點樣呢?

先由科幻回到現實,Web 2.0 社交媒體的其中一個問題是言論審查。不透明,不知準則。現的社交媒體表面上有不同社群,但其中運作方式是十分單一化,管理員係永續執政的,發生管理問題時,成員只有離開重組才可以改變,不能改準則或管理員,但離開社群時,大家的記錄就失去了。這比線下世界的社群差太多了。

其實EV Terminators 設定及社交媒體問題核心,是大眾的資料是儲存在科技企業中。企業有權改規則,使用者條款,但民眾因為自己的資料被科技企業綁架,就算不了解軟件的風險,要強制升級。而科技企業卻沒有做好測試工作,如蘋果的ios連續兩年過年後都有鬧鐘失靈問題。

科技巨企同AI有很多類似的地方,他們不是生命,會不停成長,不會死,仲可能散到世界各地。

如果當科技巨企為了永續存在,同人類生存或人性衝突,巨企會否傷害部份人類?AI 係科技巨企的產品,不應該它們出錯,而用戶(我們)要埋單。

當ChatGPT 出現後,部份人對AI產生恐慌,AI雖然功能強大,但AI同核能科技一樣,暫時只是科技,我們因為恐懼而關注AI及核能,我們應否更關注它們的操控者?

政府可以做什麼?

立法規管?如果立法是減慢發展或使用,基本上是沒有可能,因為這會減慢自己地區應用科技。出問題時罸錢阻嚇,錢對科技巨企都係九牛一毛,再多的罸款最後都會轉移到消費者身上,而且當傷害己發生時,錢未必幫到受害人。在政府科技落後於科技巨企,有冇可能學傳統家電,科技要通過一些測試才可使用或升級,去保護大眾?

科幻角度的答案

真正既元宇宙,可能能解決到。元宇宙係指國家為單位的社會外出現一個建基於網絡的完整社會體系,一個完整社會體系又點會得單一社群,而法規也不應由少數人決定,元宇宙社群可以如何體現呢?

元宇宙在網絡空間進行,法則自然由文字的普通法變成程式代碼,以智能合約,寫在區塊鏈上。

用戶透過化身同去投票審批加入或更新法例。用戶不明白程式怎麼辦?同現時我不明白法例條文一樣,把權交給代議用戶幫手。最大不同是這個權力用戶可以隨時回收及轉人,而且智能合約寫在不能刪除的區塊鏈,有需要時用戶可以啓動還原程序,行回上一版本的法規。

同理,如果軟件是寫在用戶的區塊鏈(公鏈)上,不能清洗,用戶有權選擇升級或降級,減少AI/科技企業出錯的影響。

回到現實,政府當然可以立法要求軟件一定有降級方案,才可以推新版本。科技巨企當然用各種理由去辯解不可能(如技術難度,用錢,用戶不關心)等原因。這些理由當然有真有假。當我們不關心,我們就被代表了。

如果想科技巨企可以規管,我們就要小心自己的生活習慣去創造可能

-

對科技巨企零信任 — (Zero trust)減少把自己的資料留在他們手上。

-

減少把自己身分同單一企業連結 — 即不要把所有服務都連結 XX id 登入。可以想像要有一個以上的銀行戶口,如在海外旅遊時其中一個不能提錢,都有後備可用。

-

控制自己的個人資料 — 當資料在自己手,大家有權選擇用不同的服務供應商。

可能大家會覺得生活會少了一些方便,這時候大家可能要參加建基在區塊鏈的數碼公民社會組織(分享自己的電腦成為節點),令這些組織服務(如共享檔案儲存)成為科企外的選擇。當有選擇時,科企才較易被規,同時這些離散的區塊鏈,可能係真正元宇宙的第一步。

AI 對於人類的影響應不是工作消失,而是在資本主義社會下人們把學習,係為了工作,搵錢這價值的作出挑戰。這方面我就留給哲學家去討論。

原文是明報20230530 及 20230606世紀版,二元對坐刊出。

世紀.二元對坐:科幻有理 從科幻小說預視未來問題(上) / 文.天馬先生/編輯.呂晞頌 - 20230530 - 作家專欄

世紀.二元對坐:科幻有理:從科幻小說預視未來問題(下) / 文.天馬先生/編輯.吳騫桐 - 20230606 - 作家專欄

文章版权归原作者所有。